AI 生成 X 光片極逼真!研究指放射科醫生及 AI 皆難百分百辨識真偽

隨住生成式 AI 技術成熟,ChatGPT 等大型語言模型已經可以製作出極度逼真嘅「Deepfake」醫療 X 光片。最新研究指出,超過一半不知情嘅放射科醫生未能發現影像由 AI 生成;即使預先提醒,醫生辨識準確率亦只得約 75%。更值得關注嘅係,各大 AI 模型互相測試下,亦無一能夠完全識破假相。呢項發現揭示醫療界正面臨全新挑戰,未來亟需引入數碼浮水印防範造假。

隨住人工智能技術一日千里,生成式 AI 嘅應用範圍已經由簡單嘅文字創作同藝術畫作,擴展到對精準度要求極高嘅醫療領域。近期,一份發表喺權威期刊《Radiology》(放射學)嘅最新研究報告指出,大型語言模型(例如 ChatGPT)已經具備生成極其逼真嘅合成醫療影像(Deepfake)嘅能力。呢啲假 X 光片嘅像真度極高,甚至連具備多年經驗嘅專業放射科專科醫生,以及目前市面上最頂尖嘅 AI 模型,都難以做到百分百準確辨識。呢個現象引起咗醫學界對於醫療影像被濫用、病歷造假以及數據庫被污染嘅高度關注。

醫療界正面臨嘅 Deepfake 危機

根據呢份由 Mickael Tordjman 醫生及其團隊進行嘅回顧性診斷準確度研究,AI 系統目前已經可以根據簡單嘅文字指令,無中生有咁生成出包含各種病理特徵(例如骨折、腫瘤、感染等)嘅 X 光片。為咗測試人類同機器對呢啲假相嘅辨識能力,研究團隊邀請咗來自六個國家嘅 17 位放射科醫生參與測試,同時亦安排咗四款主流嘅 AI 模型進行評估。結果發現,喺唔知道有假相混入嘅情況下,只有 41% 嘅醫生主動察覺到有異樣;而即使喺被明確告知有 AI 生成影像存在之後,醫生嘅平均分辨準確率亦只得 74.8%。換言之,每四張 AI 假相入面,就有一張成功瞞天過海。

新聞詳細本體:專業醫生能否睇穿 AI 嘅偽裝?

跨國醫生參與嘅三階段嚴格實驗

呢項研究喺 2025 年 4 月至 8 月期間進行,參與嘅 17 位放射科醫生來自香港人熟悉嘅醫療發達國家,包括美國、英國、法國、德國、土耳其同阿聯酋。醫生嘅年資分佈非常廣泛,由剛接受專科培訓嘅醫生,到擁有 40 年豐富經驗嘅資深專家都有參與,平均年資為 8 年。佢哋嘅專業範疇涵蓋肌肉骨骼影像、胸部影像、身體影像、介入放射學同核子醫學等。

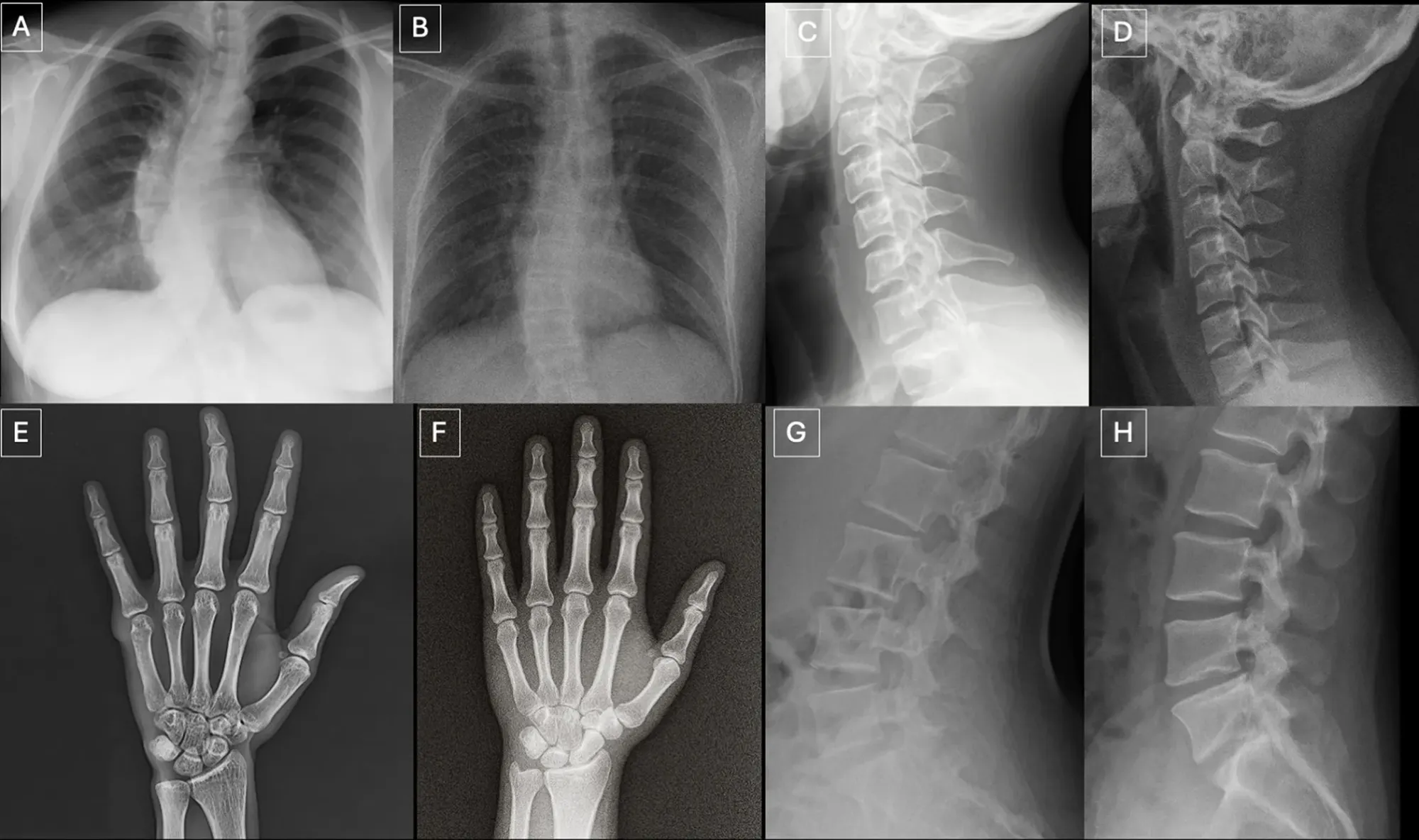

實驗分為三個階段進行。喺第一階段(盲測階段),醫生並唔知道研究嘅真正目的,佢哋需要為 154 張不同部位嘅 X 光片(當中 77 張係真實臨床影像,另外 77 張係由 GPT-4o 生成嘅假相)進行影像質素評分同診斷。結果顯示,醫生對真假相片嘅質素評分相當接近,而且只有 7 名醫生(約 41%)自然咁發覺部分相片有古怪,懷疑係由 AI 生成。

知情測試結果:經驗多寡並非絕對優勢

進入第二階段後,研究團隊向醫生公開咗測試嘅真正目的,並要求佢哋明確指出邊啲相係真、邊啲係假。結果發現,醫生整體嘅平均準確率為 74.8%。當仔細分析醫生嘅背景同表現時,團隊發現年資長短同準確率之間並冇直接嘅線性關係;不過,專攻肌肉骨骼影像嘅放射科醫生表現的確比較好,準確率達到 83.0%,相比之下其他專科醫生嘅平均準確率得 70.3%。

研究嘅第三階段引入咗另一批由專門針對胸部 X 光訓練嘅 AI 模型「RoentGen」所生成嘅假相,要求醫生分辨。結果顯示,醫生分辨 RoentGen 假相嘅準確率為 70.0%,同分辨 GPT-4o 假相嘅表現差唔多。有趣嘅係,數據分析指出,如果醫生花特別長嘅時間去思考同作答,佢哋答錯嘅機會反而會增加,反映出當面對極度逼真嘅假相時,過度解讀反而容易產生誤判。

AI 與 AI 嘅大比拼:無一能完美過關

除咗測試人類醫生,研究團隊亦安排咗四款目前最先進嘅多模態大型語言模型進行測試,要求佢哋分辨真假 X 光片。呢四款模型分別係 OpenAI 嘅 GPT-4o 同 GPT-5、Google 嘅 Gemini 2.5 Pro,以及 Meta 嘅 Llama 4 Maverick。

測試結果顯示,冇任何一款 AI 可以百分百找出所有假相。當中表現最好嘅係「始作俑者」GPT-4o,佢分辨由自己生成嘅假相時準確率有 85.1%,而 GPT-5 亦達到 82.5%。相反,Gemini 2.5 Pro 同 Llama 4 Maverick 嘅表現就明顯遜色,準確率分別只有 56.5% 同 59.1%。即使 AI 可以識別出部份破綻,但整體表現依然反映出 AI 生成技術已經超越咗現有嘅自動檢測能力。

AI 生成 X 光片嘅四大破綻:點樣拆解 Deepfake 影像?

雖然 AI 生成嘅 X 光片極具欺騙性,但綜合參與醫生同 AI 模型嘅回饋,目前呢啲合成影像依然存在一啲共通嘅破綻。了解呢啲細微嘅異常之處,有助醫療人員提高警覺:

- 過度完美嘅對稱性:人體結構喺現實中總會有些微嘅不對稱,但 AI 往往會生成出好似倒影一樣、左右完美對稱嘅影像。例如肺部兩側嘅紋理過於一致,或者脊椎骨排列得太過筆直(除非喺指令中特別要求加入脊柱側彎)。

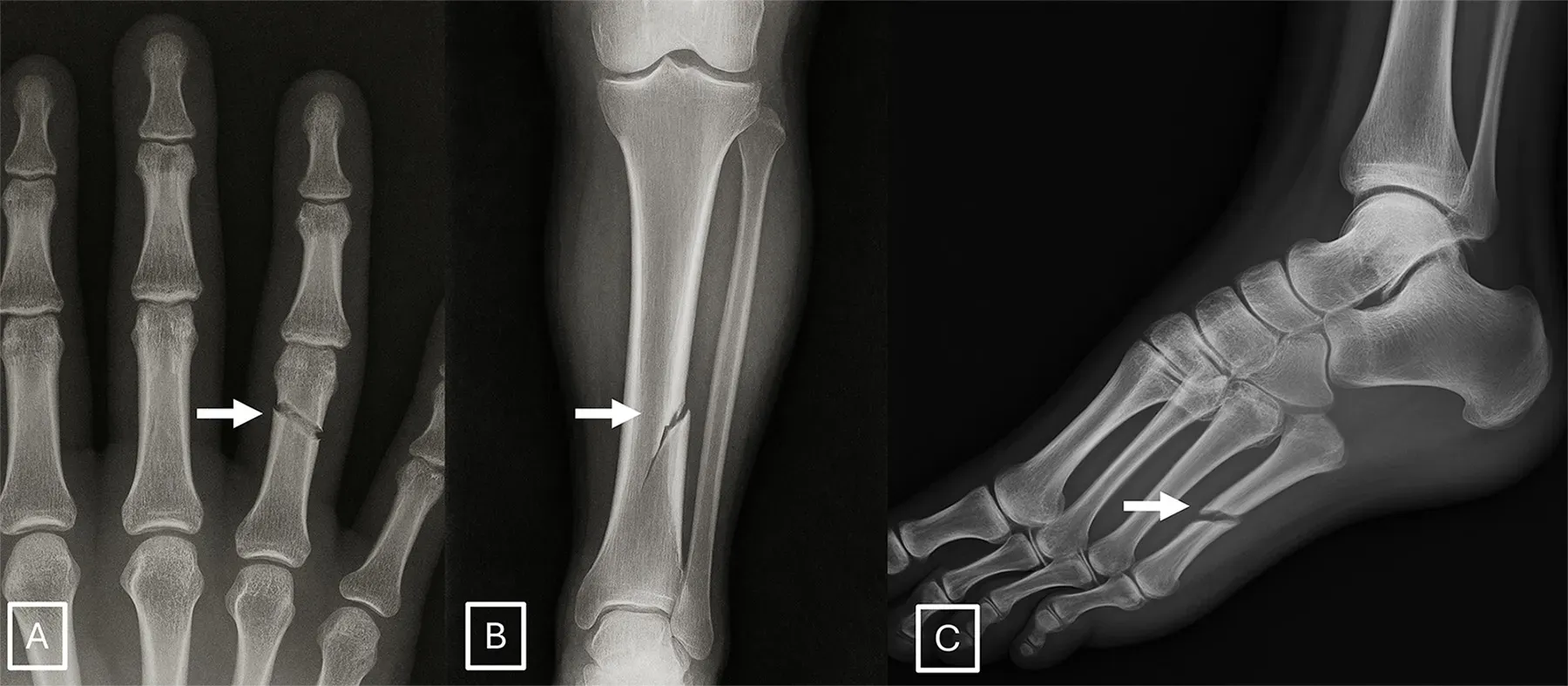

- 骨頭表面過於平滑:真實嘅骨骼邊緣通常會有自然嘅微小凹凸或不規則特徵(例如腰椎嘅 Schmorl 結節)。而 AI 畫出嚟嘅骨頭,皮質骨厚度往往均勻得唔自然,骨折線亦經常顯得太乾淨、太平滑,甚至只係出現單邊皮質骨折斷嘅不合理情況。

- 統一而呆板嘅雜訊分佈:真實嘅 X 光片會因為設備同人體組織密度而產生不同程度嘅顆粒感。但 AI 生成影像嘅雜訊模式通常會呈現出完全一致、均勻分佈嘅狀態,缺乏層次感。

- 軟組織細節缺失或唔自然:AI 有時會忽略咗一啲微小但必要嘅解剖細節,例如手部 X 光片入面會無端端缺少咗指甲床嘅陰影,或者植入嘅醫療金屬器材邊緣異常鋒利。

AI 醫療影像帶來嘅潛在風險與防範措施

隨著利用 ChatGPT 等工具生成逼真醫療相片嘅技術門檻大幅降低,只需輸入簡單嘅文字指令就能夠獲得假相,呢種便利性同時帶嚟咗嚴重嘅安全隱憂。

保險詐騙與醫療記錄造假

首先,不法分子可以利用呢啲工具輕易偽造帶有骨折或特定疾病嘅 X 光片,用嚟騙取保險賠償或工傷假期。此外,一啲患有「孟喬森症候群」(Munchausen syndrome,即刻意偽造症狀以獲取醫療關注嘅心理疾病)嘅病人,亦可能會利用假影像去誤導醫生。一旦呢啲惡意捏造嘅 X 光片混入電子病歷系統,將會直接導致錯誤診斷,甚至引發嚴重嘅醫療事故同法律訴訟。

數據庫污染問題

從研究層面睇,目前有好多 AI 醫療輔助工具依賴大量真實臨床數據進行訓練。如果有人將假嘅 X 光片上傳並滲透到開源或醫院嘅研究數據庫中,將會引發「數據中毒」(Data Poisoning),令到未來開發嘅醫療 AI 演算法產生嚴重偏差。

數碼浮水印與區塊鏈技術成為出路

為咗應對呢場即將來臨嘅危機,研究團隊強調必須引入多層面嘅防範措施。技術上,可以考慮喺 AI 模型生成影像時,強制嵌入肉眼睇唔到嘅數碼浮水印(Digital Watermarking)或者喺檔案標頭加入特定標記。同時,醫療機構可以結合密碼學雜湊(Cryptographic Hashing)同區塊鏈(Blockchain)技術,為每一張真實嘅臨床 X 光片建立獨一無二、無法篡改嘅數碼指紋同存取紀錄。一旦影像被修改或來源不明,系統就可以即時發出警告。

事實與數據整理

以下係本新聞提及嘅核心數據與測試結果一覽,方便讀者快速掌握重點:

- 研究對象:17 名放射科專科醫生(年資 0 至 40 年不等)及 4 款主流大型語言模型。

- 醫生盲測發現異樣比例:41%(17 人中得 7 人自然察覺)。

- 醫生知情下辨識 GPT-4o 假相平均準確率:74.8%。

- 專科醫生表現差異:肌肉骨骼影像專科醫生(83.0%)對比 其他專科醫生(70.3%)。

- 各 AI 模型辨識 GPT-4o 假相準確率:

- GPT-4o(OpenAI):85.1%

- GPT-5(OpenAI):82.5%

- Llama 4 Maverick(Meta):59.1%

- Gemini 2.5 Pro(Google):56.5%

總結:科技發展與醫療安全需要同步

AI 影像合成技術嘅進步無疑為醫學教育同罕見疾病研究提供咗強大嘅輔助工具。例如利用合成影像作為教學素材,可以免除病人私隱外洩嘅風險。不過,科技嘅雙面刃效應亦喺呢項研究中表露無遺。當生成式 AI 嘅像真度連專科醫生同機器自己都難以分辨時,醫療機構、政策制定者同 AI 開發商就必須通力合作。一方面要設立嚴格嘅指引同驗證機制,另一方面亦需要為前線醫療人員提供針對性嘅持續進修培訓,確保佢哋具備辨識 Deepfake 影像嘅基本知識。只有確保每一張作為診斷依據嘅相片都絕對真實,醫療系統嘅公信力同病人嘅安全先至可以得到真正嘅保障。