Mac Mini 配合 Ollama 及 Gemma 4:Gemini Pro免費替代(附教學)

近年生成式人工智能發展迅速,雲端訂閱服務雖然方便,但數據私隱與長期成本往往成為企業及開發者考慮嘅因素。本文將詳細探討如何利用具備統一記憶體架構嘅 Mac Mini,配合開源工具 Ollama 以及 Google 最新推出嘅 Gemma 4 模型,喺本地環境以較低成本建立一套效能接近 Gemini 嘅人工智能系統,並提供完整設定教學及應用情境分析,助讀者評估本地部署 AI 嘅可行性。

Mac Mini 配合 Ollama 及 Gemma 4:本地端運行免費人工智能教學與效能分析

近年,生成式人工智能(Generative AI)已經成為科技界不可或缺嘅技術。好多用家習慣使用 Google Gemini 或者 ChatGPT 呢類雲端服務嚟協助處理日常工作。不過,隨住使用頻率增加,數據私隱以及每月累積落嚟嘅訂閱費用開始成為唔少用家同企業關注嘅重點。喺呢個背景下,利用本地硬件運行開源 AI 模型成為咗一個備受重視嘅新趨勢。

呢篇文章會詳細分析點樣利用 Apple 嘅 Mac Mini,配合開源系統 Ollama 同埋 Google 推出嘅 Gemma 4 模型,去建立一個屬於自己、免月費而且保障私隱嘅本地 AI 平台,同時會提供實用嘅設定教學與效能比較。

點解要選擇本地部署人工智能?

喺探討具體教學之前,我哋首先要了解本地部署(Local Deployment)比起雲端服務有咩實際優勢。

第一,保障數據私隱與安全。雲端 AI 雖然方便,但係用家需要將指令同數據上傳到第三方伺服器。對於處理機密商業資料、客戶個人資料或者未公開源代碼嘅開發者嚟講,呢個做法存在一定嘅外洩風險。本地部署可以做到「數據不出門」,所有運算都喺自己部電腦度完成,從根本解決私隱疑慮。

第二,減低長期營運成本。主流 AI 服務嘅高級版本通常需要每月支付約百幾二百蚊港紙嘅訂閱費。雖然單月睇落唔算貴,但長期累積,或者企業需要為多名員工購買帳號時,就係一筆龐大開支。本地部署雖然需要前期嘅硬件投資,但往後就唔需要再支付任何軟件訂閱費。

第三,離線使用嘅便利性。本地部署嘅 AI 系統唔依賴互聯網連線,即使喺網絡不穩定或者完全離線嘅環境下,依然可以正常運作。

核心組件分析:Mac Mini、Ollama 同 Gemma 4

要打造呢個免費嘅「專屬 Gemini」,我哋需要三個核心元素:硬件、運行平台以及人工智能模型。

1. 硬件平台:Mac Mini 嘅統一記憶體優勢

運行大型語言模型(LLM)最耗費嘅資源並唔係處理器運算能力,而係顯示卡記憶體(VRAM)。喺傳統 PC 陣營,要買一張具備 24GB VRAM 嘅頂級顯示卡(例如 RTX 4090),動輒需要成萬蚊港紙。

相反,Apple Silicon(例如 M2, M4 等晶片)採用咗統一記憶體架構(Unified Memory Architecture)。呢個設計容許系統記憶體(RAM)同顯示晶片共用同一組記憶體。換言之,如果你買一部配備 32GB 甚至 64GB 記憶體嘅 Mac Mini,系統就可以撥出大部分記憶體當作 VRAM 畀 AI 模型使用。相比起配置同等 VRAM 嘅 PC,Mac Mini 提供咗一個性價比極高嘅硬件基礎,加上佢體積細小、功耗極低,非常適合長時間開機作為本地 AI 伺服器。

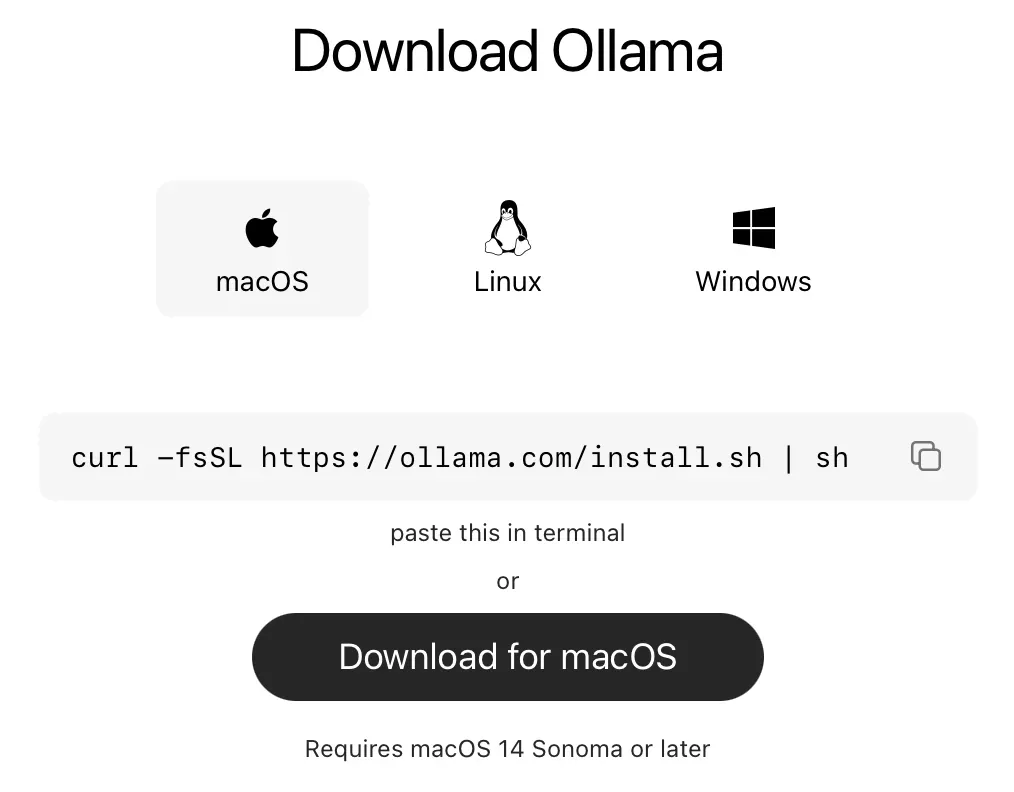

2. 運行平台:Ollama

Ollama 係一個專為 macOS、Linux 同 Windows 設計嘅開源應用程式。以往要喺本地運行 AI 模型,用家需要設定複雜嘅 Python 環境、安裝各種依賴庫(Dependencies),門檻非常高。Ollama 嘅出現將整個過程簡化成幾個簡單嘅指令。佢內置咗多款熱門開源模型嘅支援,並且會自動處理硬件加速嘅設定,令一般用家都可以輕鬆啟動本地 AI。

3. AI 模型:Google Gemma 4

Gemma 係 Google 基於研發 Gemini 模型嘅技術同基礎架構所打造嘅開源模型系列。Gemma 4 作為最新世代,喺邏輯推理、編程輔助以及多國語言處理(包括繁體中文)方面都有顯著提升。由於佢採用咗開放權重(Open Weights)形式發布,開發者同一般用家可以免費下載到本地運行。Gemma 4 通常會提供不同參數規模嘅版本(例如 9B 參數、27B 參數等),用家可以根據自己 Mac Mini 嘅記憶體大小去選擇最適合嘅版本。

效能與體驗比較:雲端 Gemini vs 本地 Gemma 4

喺決定投資硬件之前,我哋有必要客觀比較雲端版本同本地版本嘅差異。

| 比較項目 | 雲端 AI 服務 (如 Gemini Advanced) | 本地 AI (Mac Mini + Ollama + Gemma 4) |

|---|---|---|

| 運算速度 | 極快(依賴龐大伺服器群) | 視乎 Mac Mini 晶片級數,通常反應稍慢 |

| 知識更新 | 可實時連接網絡搜尋最新資訊 | 知識停留在模型訓練截斷日期,需額外掛載工具聯網 |

| 私隱安全 | 需上傳數據,受制於平台私隱條款 | 最高,數據完全留在本地硬碟 |

| 成本 | 每月訂閱費(約 HK$150+) | 零軟件訂閱費,僅需支付硬件買斷費及極少電費 |

| 使用限制 | 受平台字數、次數及內容審查限制 | 無任何使用次數限制,可完全自訂 |

從上表可見,本地部署並唔係要完全取代雲端服務,而係提供一個喺私隱同成本控制上更有利嘅選擇。對於需要處理最新即時資訊嘅任務,雲端服務依然有優勢;但如果工作涉及大量內部文件分析或編程代碼生成,本地部署就更為合適。

實用教學:喺 Mac Mini 安裝 Ollama 及 Gemma 4

如果你已經準備好一部合適嘅 Mac Mini(建議最少配備 16GB 記憶體,32GB 或以上會有更好體驗),可以跟住以下步驟建立你嘅 AI 系統。

步驟一:下載及安裝 Ollama

- 前往 Ollama 官方網站下載安裝檔:前往 Ollama 官網。

- 下載 macOS 版本後,解壓縮並將應用程式拖入「應用程式(Applications)」資料夾。

- 首次開啟時,系統會要求安裝命令列工具(Command Line Tools),請點擊同意並輸入系統密碼完成授權。

- 當見到右上角狀態列出現 Ollama 嘅羊駝圖示,就代表背景服務已經成功啟動。

步驟二:透過終端機下載及運行 Gemma 4

Ollama 採用終端機(Terminal)作為主要操作介面。

- 喺 Mac 打開「終端機」應用程式。

- 系統會自動開始下載模型檔案。視乎你嘅網絡速度,可能需要幾分鐘到十幾分鐘不等。

- 下載完成後,終端機會出現

>>>嘅提示符號。呢個時候,你已經可以直接輸入文字同 Gemma 4 進行對話。

輸入以下指令以拉取(Pull)並運行 Gemma 4 模型(此處以 9B 版本為例,具體標籤名稱請參考 Ollama 官方模型庫最新資訊):Bash

ollama pull gemma4適合對象與使用情境說明

呢套 Mac Mini + Ollama + Gemma 4 嘅組合,到底最適合邊類型嘅讀者?

- 軟件工程師與程式開發者:寫 Code 嘅時候經常需要 AI 協助除錯(Debug)或生成代碼。由於商業代碼具有高度機密性,利用本地 Gemma 4 進行代碼輔助可以完全避免源代碼外洩。

- 中小企管理層或數據分析人員:當需要分析公司內部嘅銷售數據、客戶名單或者財務報表時,將呢啲資料輸入本地 AI 模型進行總結或趨勢分析,符合企業安全合規要求。

- 內容創作者與編輯:如果需要 AI 協助構思大綱、校對文章,本地模型可以無限制咁生成內容,無需擔心觸及雲端 API 嘅用量上限。

總結

利用 Mac Mini 配合 Ollama 同 Gemma 4 構建本地人工智能系統,展現咗現今開源科技嘅強大潛力。Apple Silicon 獨特嘅統一記憶體架構大幅降低咗運行大型語言模型嘅硬件門檻,令一般消費者或中小企都可以擁有一台強大嘅本地 AI 伺服器。

雖然本地部署喺模型知識更新速度同埋極致運算效能上,未必能夠完全媲美最頂級嘅付費雲端服務,但佢喺數據私隱保障、自訂彈性以及長期成本控制方面,提供咗一個非常具競爭力嘅替代方案。對於有意深入應用人工智能而又重視資料安全嘅讀者嚟講,呢個配置無疑係一個值得探討同實踐嘅技術方向。

Comments ()